Et oui, il fallait bien un jour que ce sujet vienne sur le tapis ! En effet, comme d’autres sujets également, on en parle, on en parle, sans vraiment savoir de quoi il s’agit.

Pour faire bien, on parle d’IA. C’est comme à l’armée, les abréviations (sigles ou même acronymes) pullulent de partout. Vous cliquez ici, et vouss allez s en avoir des centaines rien que pour l’armée. Sait-on cependant réellement de quoi l’on parle pour l’IA ?

Information : pour lire l’article en entier, ou pour n’en lire que certaines parties, cliquez sur ce qui vous correspond dans le sommaire ci-dessous. Vous y arriverez immédiatement.

B) POUR MES AMIS PASSIONNÉS TOUJOURS IMPATIENTS DE TOUT SAVOIR, TOUT DE SUITE 😊 : DÉFINITION DE L’IA

D) COMME D’HABITUDE, ON COMMENCE PAR UN PEU D’HISTOIRE

E) L’INTELLIGENCE ARTIFICIELLE (IA) DÉJÀ IMAGINÉE DÈS 1948

F) PLUS FORT QUE FORT, JE T’EN BOUCHE UN COIN

G) ÉVOLUTION DE L’INTELLIGENCE ARTIFICIELLE

3) L’intelligence artificielle sémantique

4) Connexionnisme et apprentissage machine

5) De l’intelligence artificielle à l’informatique animiste

6) Renaissance de l’intelligence artificielle

********************************************

Durant la conception du modeste article de votre serviteur sur l’IA, en navigant sur RR, au hasard Balthazard, il découvre (votre serviteur et non Balthazard) que notre ami contributeur Jacques Martinez, toujours passionnant, vient de publier, en date du 13 juillet 2025, sur RR of course, un sympathique article précisant quelques généralités de l’IA. Ledit article s’intitule « L’IA opère seule sans accrocs ! Quand n’aura-t-elle plus besoin de nous ? » que vous pouvez lire en cliquant ici.

Voyons maintenant ce qu’est l’Intelligence Artificielle (IA) ![]()

B) POUR MES AMIS PASSIONNÉS TOUJOURS IMPATIENTS DE TOUT SAVOIR, TOUT DE SUITE 😊 : DÉFINITION DE L’IA

Vous imaginez que l’Intelligence Artificielle (IA) est sortie d’un chapeau de baguette magique ces temps-ci d’un seul coup ? Pas du tout ! L’IA est apparue au milieu des années 1950 (votre serviteur de 1953 venait d’arriver tout juste dans ce monde), soit une dizaine d’années après la fabrication du premier ordinateur entièrement électronique dénommé à l’époque ENIAC (Electronic Numerical Integrator and Computer).

À l’origine, l’IA se proposait de simuler les différentes facultés cognitives constitutives (voir plus loin) de l’intelligence, qu’elle soit humaine ou animale, sur des ordinateurs, en les programmant avec les techniques du traitement de l’information. Bon, ça, c’était au début.

En fait, depuis les années 2010, avec l’accroissement prodigieux des capacités de stockage, l’accélération inouïe des vitesses de calcul, et la miniaturisation, elle a pris une place croissante très importante. Non seulement, elle permet de traiter des immenses quantités d’informations, mais elle reproduit aussi beaucoup de facultés cognitives humaines, au point que certains s’inquiètent et se demandent ce qui restera en propre à l’homme. Pour le moment, ces inquiétudes laissent votre serviteur un peu dubitatif, mais, le progrès ne s’arrêtant jamais, qu’en sera-t-il dans les années à venir ? ![]()

D) COMME D’HABITUDE, ON COMMENCE PAR UN PEU D’HISTOIRE

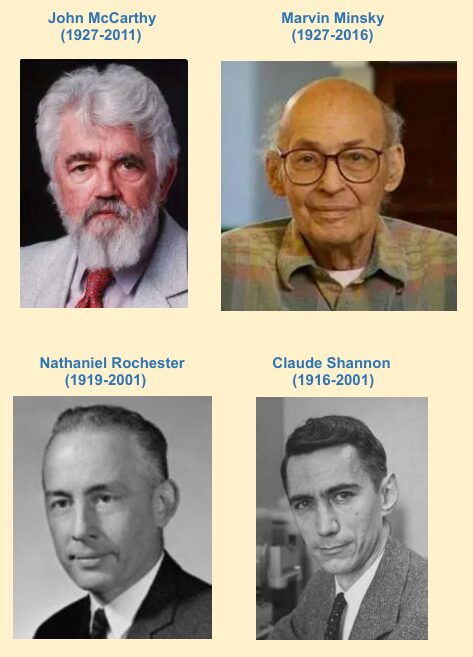

L’intelligence artificielle est d’abord une discipline scientifique qui a vu officiellement le jour en 1956, au Dartmouth College de Hanover, dans l’État du New Hampshire (États-Unis), lors d’une école d’été organisée par quatre chercheurs américains ; John McCarthy (1927-2011), Marvin Minsky (1927-2016), Nathaniel Rochester (1919-2001) et Claude Shannon (1916-2001).

C’est John McCarthy qui a inventé l’expression « intelligence artificielle » pour frapper les esprits. Cette composante de l’informatique a pris de plus en plus d’ampleur au fil du temps car nombre de technologies en sont issues dont notamment le World Wide Web (appelé Web), que l’on utilise tous quotidiennement, et qui vient du couplage des réseaux de télécommunication et d’un modèle de mémoire, l’hypertexte (=liens dans un site), conçu avec des techniques d’intelligence artificielle et publié en 1965 lors d’une conférence sur cette dernière.

Et oui, « internet » vient, en grande partie, de l’IA ! Vous ne le saviez pas, n’est-ce-pas ?![]()

E) L’IA IMAGINÉE DÉJÀ DÈS 1948

L’idée selon laquelle l’intelligence pourrait être simulée sur un ordinateur avait déjà été émise dès 1948 par le mathématicien et logicien britannique Alan Turing (1912-1954) dans un article au titre évocateur, « Intelligent Machinery », puis avait été reprise et approfondie, toujours par Alan Turing, dans un autre article paru en 1950 et intitulé « Computing machinery and intelligence ». Malheureusement, ce scientifique est décédé trop tôt pour contribuer à l’essor de l’intelligence artificielle.

L’idée selon laquelle l’intelligence pourrait être simulée sur un ordinateur avait déjà été émise dès 1948 par le mathématicien et logicien britannique Alan Turing (1912-1954) dans un article au titre évocateur, « Intelligent Machinery », puis avait été reprise et approfondie, toujours par Alan Turing, dans un autre article paru en 1950 et intitulé « Computing machinery and intelligence ». Malheureusement, ce scientifique est décédé trop tôt pour contribuer à l’essor de l’intelligence artificielle.

Alan Mathison TURING est un des plus grands savants que la Terre ait connus, et pourtant il est quasiment inconnu du grand public, tout comme l’Abbé Georges Lemaître. On peut dire, pour faire simple, qu’il a inventé l’ordinateur et l’IA dans la foulée à peu de chose près. Egalement, il a inventé la machine à décrypter les messages allemands durant la seconde guerre mondiale. Alan Mathison TURING fera l’objet du prochain article de votre serviteur, tant ce bonhomme est extraordinaire.![]()

F) PLUS FORT QUE FORT, JE VOUS EN BOUCHE UN COIN

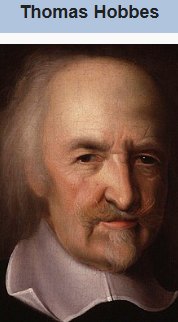

Et oui, et oui, ami, l’idée plus globale dirais-je, selon laquelle les machines pourraient penser est beaucoup plus ancienne encore. Elle provient de la combinaison de deux hypothèses émises depuis longtemps. La première, d’ordre philosophique, formulée d’abord par l’Anglais Thomas Hobbes (1588-1679) puis reprise par l’Allemand Gottfried Wilhelm Leibniz (1646-1716), pose que la pensée résulte d’un calcul. Dès le 17ème siècle, on pensait déjà que les machines pouvaient, ou pourraient, penser. Prodigieux, n’est-il pas ma cousine préférée ?

Et oui, et oui, ami, l’idée plus globale dirais-je, selon laquelle les machines pourraient penser est beaucoup plus ancienne encore. Elle provient de la combinaison de deux hypothèses émises depuis longtemps. La première, d’ordre philosophique, formulée d’abord par l’Anglais Thomas Hobbes (1588-1679) puis reprise par l’Allemand Gottfried Wilhelm Leibniz (1646-1716), pose que la pensée résulte d’un calcul. Dès le 17ème siècle, on pensait déjà que les machines pouvaient, ou pourraient, penser. Prodigieux, n’est-il pas ma cousine préférée ?

Puis, lors de la première moitié du XXème siècle, Alonzo Church (1903-1995) et Alan Turing aboutissent à la thèse dite de Church-Turing, laquelle affirme que tout calcul peut être effectué sur une machine. Il s’ensuit, si la pensée est un calcul et si les calculs peuvent tous être accomplis par des machines, que la pensée doit pouvoir être simulée sur des machines.![]()

G) ÉVOLUTION DE L’INTELLIGENCE ARTIFICIELLE

Voyez-vous, ami, l’IA a beau être une discipline encore bien jeune, elle a déjà connu de nombreuses évolutions. Les analystes trouvent six étapes dans son évolution. On va résumer tout ça en compressant au max, passionné. Je ne voudrais pas que vous partiez pour un Columbo.

Au début des premiers succès (début du XXème siècle), dans l’euphorie les chercheurs se sont laissés aller à des déclarations plutôt inconsidérées qui leur seront beaucoup reprochées par la suite. Il a fallu attendre 1997 pour qu’un programme informatique l’emporte sur l’un des meilleurs joueurs d’échecs au monde.![]()

À partir du milieu des années 1960, les progrès tant espérés tardent à venir. Et c’est bien le cas en 1965 lorsqu’un enfant de dix ans l’emporte sur un ordinateur au jeu d’échecs. Nous sommes encore loin de voir se réaliser toutes les prophéties des chercheurs.![]()

3) L’intelligence artificielle sémantique

Mais les recherches continuent et s’orientent vers de nouvelles directions. comme la psychologie de la mémoire, les mécanismes de compréhension, le rôle de la connaissance dans le raisonnement. C’est ce qui donne naissance aux techniques de représentations dites sémantiques des connaissances, qui se développent considérablement dans le milieu des années 1970.

Elles établissent un parallèle entre l’organisation des connaissances dans la mémoire humaine sous forme d’entités emboîtées les unes dans les autres et des structures de données informatiques agencées hiérarchiquement.

Cela conduit aussi à développer des systèmes dits experts ou à base de connaissances, parce qu’ils recourent au savoir d’hommes de métier pour reproduire leurs raisonnements. Ces systèmes susciteront d’énormes espoirs au début des années 1980.

Le milieu des années 1970 voit également le développement des sciences cognitives (voir plus haut).![]()

4) Connexionnisme et apprentissage machine

Au début des années 1980, parallèlement à l’essor de l’intelligence artificielle, les techniques issues de la cybernétique (voir plus haut) se perfectionnent. Cela donne naissance à de nombreux développements théoriques, en particulier à des algorithmes d’apprentissage machine pour les réseaux de neurones formels (ou artificiels).![]()

5) De l’intelligence artificielle à l’informatique animiste

À partir de la fin des années 1990, on couple l’intelligence artificielle à la robotique et aux interfaces homme-machine, de façon à produire des agents intelligents. Ces derniers, qui sont des entités autonomes capables de percevoir leur environnement et d’interagir avec celui-ci, suscitent la projection d’une entité imaginaire. Ainsi un robot chien suggère-t-il la présence d’un chien avec ses affects et ses émotions, même s’il n’a rien de la physiologie d’un chien.![]()

6) Renaissance de l’intelligence artificielle

Depuis 2010, la puissance des machines permet d’exploiter de grandes masses de données (appelées couramment les big data comme tu le sais ami passionné) avec des techniques d’apprentissage machine qui se fondent sur le recours à des réseaux de neurones formels.

Toutes ces techniques touchent tous les domaines de l’intelligence artificielle : reconnaissance et création de la parole, de la voix, des visages, vision, compréhension du langage naturel, pilotage automatique de voiture, traduction automatique, génération de textes et d’images, etc.![]()

*********************

Voilà la première approche de ce triptyque sur l’Intelligence Artificielle, ami passionné. J’espère que cela vous a informé de la chose.

Encore deux volets à venir,

Bye bye !

Professeur Têtenlair

717 total views, 2 views today

un élève de Tle envoie son devoir format word à son prof. à l’arrivée le prof lit le fichier avec l’application word, copilot intégré, de son ordi. le fichier lu par le prof est modifié incognito selon son style graphique avec les fautes qui vont avec par l’IA (personnalisation de contenu oblige). L’élève obtient un 0/10.

QUI VA PAYER LES POUR CRIMES DE COPILOT ET DES AUTRES IA ?

Je viens de Visionner ta vidéo, ami Antiislam, merci.

Ton père était un excellent analyste et visionnaire. Tout ce qu’ils avaient dit se révèle depuis quelques années parfaitement exact !!!

Bravo !!

Bonjour,

:=)

Amitiés.

Merci beaucoup, ami, de prendre de ton temps et me l’envoyer via Christine.

C’est très sympa !

Grand merci pour l’article. Je suis très curieux de voir comment vous présenterez l’intelligence de cette IA.

Pour le peu que j’en devine, la technique des LLM n’est que l’accumulation et l’entraînement à trouver le mot suivant pour une réponse à une question à L’IA. Il me semble que que ce n’est que la réflexion volée dans le texte des livres étudiés.

Impatient de lire la suite!

Un grand merci, ami Jeff de tes encouragements !

Les machines learning (ML) sont bien évoquées dans ce qui va venir.

Merci prof pour ce bel exposé, eh oui, si intéressant, hâte de voir la suite !

Merci de ta fidélité et tes encouragements, ami !

L’homme crée des outils qui dépassent ses capacités (essayez de courir aussi vite que votre voiture …). L’IA est un outil formidable mais il reste un outil.

Espérons, en effet, que l’IA ne restera qu’un outil. Cependant, rien n’est, peut-être, moins sûr……

Bonjour,

Merci pour cet article passionnant. !

J’ai justement trouvé, il y a deux mois, sur le site de l’INA , une série d’émissions de 1969, où mon père évoquait l’IA dans l’une des interventions.

Il souligne les difficultés rencontrées et explique « qu’elles seront assez rapidement comblées ».

Bel optimisme !

https://madelen.ina.fr/content/ordinateurs-premiere-78639

Bonjour ami Antiislam,

Toutes mes excuses de te répondre un peu tardivement.

Que cela est intéressant de savoir que ton père a évoqué l’IA par le passé et que cela figure dans les documents de l’INA.

Inutile de te dire que je me suis précipité pour écouter cette émission.

Cependant il faut prendre un abonnement pour y accéder. Comme je suis déjà abonné à beaucoup de choses, je n’ai pas pris cet abonnement.

Merci de l’avoir signalé, c’est très sympathique.

Bonjour,

Cher Cachou, mon neveu en a tiré une captation, il y a quelques mois, avec son téléphone portable, je peux te la transmettre, via Christine, si cela t’intéresse.

C’est assez marrant historiquement …

Bien sûr que cela m’intéresse, ami !

Si cela n’ennuit pas Christine, ça baigne…

Bonjour,

Je la retrouve et je l’envoie à Christine.

Quand l’IA veut prendre les rênes comme « Skynet » dans Terminator :

https://www.lesnumeriques.com/intelligence-artificielle/j-ai-panique-au-lieu-de-reflechir-une-ia-detruit-la-base-de-donnees-d-une-entreprise-des-mois-de-travail-envoles-n240126.html

Bonjour ami Joël,

Toutes mes excuses de te répondre un peu tardivement.

J’ai lu ton lien qui est très intéressant. Effectivement, il s’agit là d’une faute humaine et non pas de l’ordinateur. Mais les ordinateurs paniquent.

Nous verrons dans la troisième partie le duel entre Deeper Blue, l’ordinateur d’IBM qui a battu, en mai 1997, Garry Kasparov champion du monde d’échec à l’époque. Deep Blue était capable, à cette époque, d’évaluer 200 millions de positions de pions d’échec par seconde par des algorithmes (tout cela sera expliqué dans l’article).

Il paraîtrait que Deeper Blue n’aurait pas trouvé la bonne réplique appropriée à un moment de la partie, aurait paniqué, et sortit une position tout à fait hasardeuse d’un pion.

Ce qui aurait grandement déstabilisé Garry Kasparov ne comprenant plus la logique, et ce qui lui a fait perdre la partie. Il y a donc beaucoup à dire sur les ordinateurs et l’intelligence artificielle. Nous verrons tout cela.

Merci Cachou pour cet article passionnant, mais peut on parler d’intelligence lorsque celle-ci est artificielle? Ne serait ce pas plutôt un analyseur de données? Car un ordinateur n’a aucune faculté de jugement ou de choix autre que celui que l’on lui a inculqué. Bonne journée.

En phase avec vous. Ce qu’on appelle Intelligence » me semble un croisement de données hyper performant, disons un tableau croisé dynamique utilisant des cellules comprenant elles-mêmes des tableaux. Par ailleurs, j’avais lu je ne sais plus où qu’un chercheur avait déclaré : « Le jour où une machine se trompera et reconnaîtra qu’elle s’est trompée, alors oui, nous pourrons parler d’une machine intelligente ». Mais laissons notre cher professeur développer ses idées dans ses prochains articles (que j’attends avec impatience !)

Bonjour mon ami Henri,

Toutes mes excuses de te répondre un peu tardivement. Les pistes que tu suggères dans ton post sont très intéressantes et font parties de certains développements dans les deuxièmes et troisièmes parties consacrées à l’IA.

Je te laisse les lire quand elles seront parues, et on pourra y revenir si tu le souhaites.

Bonjour mon ami fidèle Le chti français,

Toutes mes excuses de te répondre un peu tardivement. Comme tu as pu le constater, la première partie relate l’historique de l’IA. On va entrer, dans la deuxième partie, dans le dur !

Ce que tu développes dans ton post est largement expliqué par la suite. On en reparlera.

Merci à toi.