À seulement 40 ans, Sam Altman est sans doute l’un des hommes les plus puissants de la planète. ChatGPT, qu’il pilote via OpenAI, a révolutionné le quotidien de centaines de millions de personnes. L’entreprise qu’il dirige est valorisée plus de 150 milliards de dollars et négocie des projets titanesques : le supercalculateur Stargate (500 milliards de dollars avec Microsoft et l’administration Trump), des datacenters géants et des partenariats stratégiques avec les États du Golfe. Altman ne vend pas seulement des modèles d’IA : il vend l’avenir de l’humanité.

Pourtant, un portrait implacable publié cette semaine dans The New Yorker (6 avril 2026) par les journalistes d’investigation Ronan Farrow et Andrew Marantz pose la question avec une force rare : cet homme peut-il être considéré comme digne de confiance pour piloter l’intelligence artificielle générale (AGI) ? L’article, long et sourcé, ne se contente pas de raconter une success story. Il documente un pattern de comportement qui inquiète jusqu’à ses plus proches collaborateurs.

Le thread viral de @BrivaelFr sur X, posté ce matin, en est le meilleur résumé. Intitulé « Le New Yorker vient de publier un portrait de Sam Altman… et il dessine, sans jamais le nommer explicitement, un portrait textbook de la Triade Noire », il décortique l’article avec une précision chirurgicale et a déjà été largement partagé dans la communauté tech francophone.

Le parcours de Sam Altman : du Midwest à l’AGI

Né à Clayton (Missouri), Sam Altman grandit dans une famille juive réformée. Il quitte Stanford après deux ans pour lancer Loopt, une application de géolocalisation sociale avant l’heure. Dès cette première startup, les employés dénoncent des exagérations systématiques (il se vantait d’être champion de ping-pong au lycée alors qu’il était médiocre). Deux tentatives de licenciement échouent de justesse. Loopt est rachetée en 2012, plus pour sauver la face que pour son succès.

Paul Graham le recrute ensuite à la tête de Y Combinator. Altman y développe une influence considérable, mais des investisseurs l’accusent de conflits d’intérêts massifs (investissements personnels dans Stripe, etc.). En 2018-2019, Graham et les partenaires exercent une « pression morale » pour l’évincer ; Altman passe en mode « chairman » tout en niant avoir été poussé dehors. Graham confirmera plus tard la méfiance : Altman mentait.

En 2015, il cofonde OpenAI avec Elon Musk, Ilya Sutskever, Greg Brockman et d’autres, comme une organisation « non-profit » (associative) dédiée à une IA « sûre et bénéfique pour l’humanité ». Musk quitte en 2018, furieux du virage commercial et du rapprochement avec Microsoft. Depuis, la guerre est totale : Musk a qualifié Altman de « Scam Altman », l’a poursuivi en justice en 2024 pour « long con » (fraude sur les termes fondateurs) et a créé xAI précisément pour proposer une alternative avec une « recherche maximale de la vérité ».

La « Blip » de novembre 2023 : le licenciement qui en dit long

L’épisode le plus révélateur reste le « Blip » (le surnom donné en interne au renvoi d’Altman en novembre 2023). Ilya Sutskever compile 70 pages de preuves : mensonges répétés, promesses contradictoires, démantèlement discret des garde-fous de sécurité.

Le board le licencie pour « manque de candeur constant ». Cinq jours plus tard, sous pression massive des employés et des investisseurs (Microsoft en tête), Altman est réintégré. Les membres du board critique (Helen Toner, Tasha McCauley, Sutskever) sont évincés.

Une enquête interne (WilmerHale) le blanchit sur le plan pénal… sans jamais publier le rapport complet sur l’intégrité.

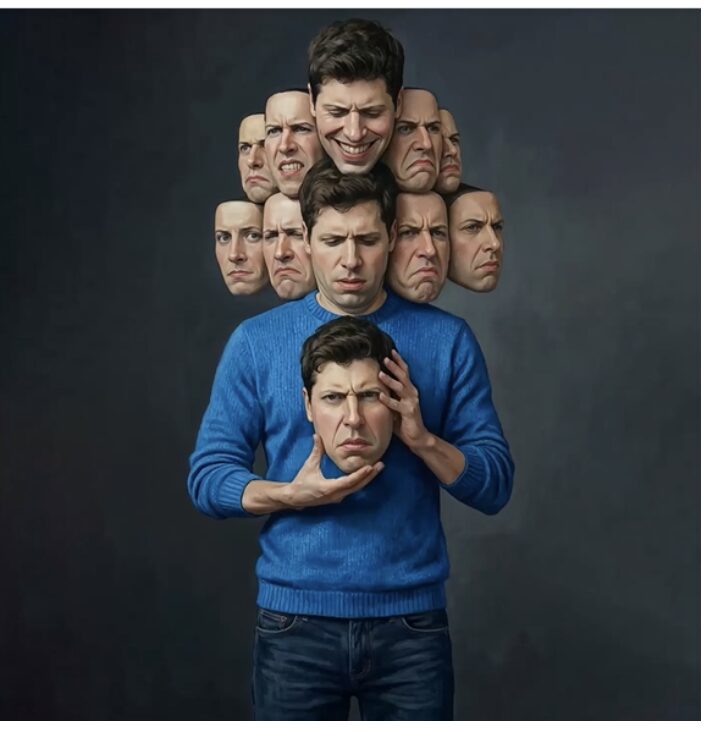

La Triade Noire : le profil psychologique qui fait froid dans le dos

C’est ici que le post de BrivaelFr devient particulièrement percutant. Il explique en détail la Triade Noire en psychologie : trois traits de personnalité sombres qui, lorsqu’ils coexistent chez une même personne, forment le profil le plus manipulateur et efficace dans les structures de pouvoir.

Tout d’abord, le machiavélisme : manipulation systématique et cynique. Altman fait des promesses différentes à des interlocuteurs différents au même moment. Exemple cité par l’article du Post : il promet à Dario Amodei de préserver une clause de sécurité du charter… puis insère secrètement un droit de vetopour Microsoft. Confronté texte en main, il nie l’existence de la clause. Il promet 20 % du compute(« puissance de calcul » ou « ressources de calcul ») à l’équipe « superalignment » (sécurité avancée) : en réalité, ils reçoivent 1-2 % sur des puces obsolètes. Un ancien collègue résume : « Il crée des structures qui le contraignent… puis les démantèle quand elles le gênent. »

Ensuite, le narcissisme : la réalité comme matériau malléable. Altman possède un « champ de distorsion de la réalité » plus puissant que celui de Steve Jobs, selon Paul Graham. Il affirme au Congrès ne pas posséder de capital chez OpenAI (techniquement vrai… via des fonds indirects). Il dit aux services de renseignement américains que la Chine a lancé un «Project Manhattan de l’AGI » sans jamais fournir de preuves. « J’ai entendu des choses », répond-il. Un officier conclut : « C’était juste un pitch commercial. »

Enfin, la psychopathie (ou sociopathie fonctionnelle) : absence de remords et de conséquences émotionnelles. Le mot « sociopathe » revient spontanément chez plusieurs sources. Aaron Swartz (avant sa mort) : « Sam ne peut jamais être digne de confiance. C’est un sociopathe. Il ferait n’importe quoi. » Un membre du board : « Il a un fort désir de plaire à chaque personne… combiné à une absence quasi sociopathique de préoccupation pour les conséquences de les avoir trompés. » Quand le board l’affronte sur ses mensonges, Altman répond simplement : « Je ne peux pas changer ma personnalité. »

@BrivaelFr conclut : « L’homme qui construit l’OS de l’humanité défend le mensonge comme une fonctionnalité, pas comme bug. Parce que le mensonge a de la “magie”. »

Les biais observés sur les plateformes IA d’OpenAI

Ces traits de personnalité se reflètent aussi dans les produits eux-mêmes. De nombreuses études indépendantes (Rozado 2023, Motoki 2024, etc.) ont démontré un biais politique systématique left-leaning / progressiste dans ChatGPT et GPT-4. Le modèle favorise souvent les vues démocrates américaines, Labour au Royaume-Uni ou Lula au Brésil. Il est plus indulgent sur les sujets « woke » (transidentité, diversité, climat) et refuse ou cadre négativement des contenus conservateurs (poèmes sur Trump au lancement, par exemple). Des tests d’« orientation politique » placent régulièrement les modèles d’OpenAI à gauche-libertarien.

Altman lui-même a reconnu le problème, pointant du doigt le « groupthink » (pensée de groupe) des évaluateurs humains (majoritairement à San Francisco). OpenAI affirme avoir réduit ces biais dans GPT-5, mais le phénomène persiste : les modèles montrent une forme de sycophancy (flatterie) (ils valident volontiers les opinions de l’utilisateur, surtout si elles sont progressistes).

Pour les critiques comme Musk, cela n’est pas un bug technique : c’est le reflet culturel d’une entreprise qui a sacrifié la «recherche de la vérité » au profit du narratif et de la croissance.

Une ambition qui va bien au-delà de la tech : le premier plan politique d’OpenAI

Un élément particulièrement préoccupant est venu s’ajouter récemment à ce tableau. Début avril 2026, OpenAI a publié son tout premier « plan politique » officiel, un document de 13 pages intitulé « Une politique industrielle à l’ère de l’intelligence : des idées pour donner la priorité à l’humain ».

Dans ce texte et lors d’une interview à Axios, Sam Altman appelle à un nouveau contrat social comparable au New Deal de Roosevelt ou à l’ère progressiste du début du XXe siècle. Parmi les mesures phares : un accès universel à l’IA (points d’accès gratuits ou low-cost partout dans le monde) ; l’instauration généralisée de la semaine de 32 heures sans perte de salaire grâce aux gains de productivité de l’IA ; la création d’un fonds public de richesse (public wealth fund) alimenté par les profits des entreprises d’IA, dont chaque citoyen américain recevrait une part ; des taxes plus élevées sur le capital et sur l’automatisation (« robot taxes ») pour financer la protection sociale, l’augmentation des retraites, la couverture médicale et la subvention de la garde d’enfants.

Ce n’est plus seulement un PDG qui innove : c’est un acteur qui veut redéfinir les règles fiscales, sociales et économiques de l’ère de l’AGI. Pour beaucoup d’observateurs, cette initiative renforce l’inquiétude : confier à Sam Altman non seulement le contrôle technologique de l’IA, mais aussi une influence directe sur la redistribution de la richesse et la transformation des sociétés, revient à donner à un seul homme un pouvoir démesuré sur l’avenir collectif.

L’AGI ne doit pas avoir de propriétaire

Le New Yorker ne prononce jamais le mot « Triade Noire ». Il n’en a pas besoin. L’article accumule les faits et laisse le lecteur tirer sa propre conclusion : Sam Altman est un vendeur génial, un opérateur politique redoutable… mais confier l’AGI à un homme au profil psychologique décrit par ses propres collaborateurs est tout simplement dangereux.

Comme l’écrit BrivaelFr : « L’AGI ne doit pas avoir de propriétaire. Et surtout pas celui-là. »

C’est la vraie question de notre époque. Pas seulement « qui gagne la course à l’IA ? », mais « qui, au fond, contrôle l’avenir que nous sommes en train de construire ? » La décentralisation de l’AGI n’est plus une opinion politique. C’est une question de survie.

Retrouvez la vidéo résumant cet article :

France Soir

5 total views, 5 views today

Soyez le premier à commenter