L’Intelligence Artificielle (IA) est capable de faire « perdre aux humains le contrôle de leur propre existence et signerait la fin de l’humanité. »

Ce n’est pas moi qui lance ce SOS mais des scientifiques et physiciens de renom -dont Elon Musk et Steve Wozniak, le cofondateur d’Apple- par la voix de l’un d’eux publiée ce samedi par Le Point :

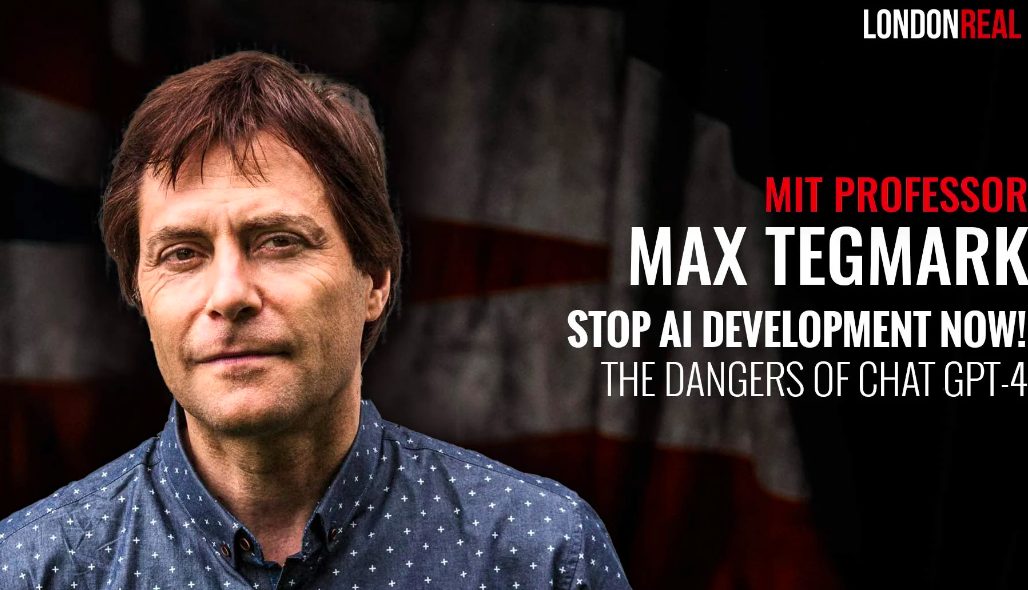

Max Tegmark, un chercheur suédois qui n’est pas gâteux, 57 ans ! Et dont la carte de visite est bien remplie : professeur au MIT -Institut de Technologie du Massachusetts, premier mondial en 2024-, dirigeant, entre autres, du FLI -Institut pour l’Avenir de la Vie-.

Ce n’est pas moi qui lance ce SOS mais des scientifiques et physiciens de renom -dont Elon Musk et Steve Wozniak, le cofondateur d’Apple- par la voix de l’un d’eux publiée ce samedi par Le Point :

Max Tegmark, un chercheur suédois qui n’est pas gâteux, 57 ans ! Et dont la carte de visite est bien remplie : professeur au MIT -Institut de Technologie du Massachusetts, premier mondial en 2024-, dirigeant, entre autres, du FLI -Institut pour l’Avenir de la Vie-.

Il est aussi à l’origine d’une lettre ouverte appelant « tous les laboratoires d’IA à interrompre immédiatement, pour une durée d’au moins six mois, la formation de systèmes d’IA plus puissants que ChatGPT-4 ».

.

Lui et ses amis sont formels : l’IA peut échapper au contrôle de l’Humain et créer elle-même -et à une vitesse infernale !- une espèce « IA » qui soit anéantira l’espèce humaine, soit la tiendra en esclavage !

Selon Le Point, le physicien « craint que cette course à une IA toujours plus puissante ne nous fasse vivre dans le réel le scénario de « La Planète des singes » !

Depuis sa lettre, « il salue la prise de conscience progressive des politiciens et du grand public, mais s’inquiète de cette course effrénée à l’AGI (Artificial General Intelligence), une IA capable de surpasser les fonctions cognitives humaines. Son avènement, il le craint, ferait perdre aux humains le contrôle de leur propre existence et signerait la fin de l’humanité. »

Personnellement, j’en ai froid dans le dos parce que je me dis que, à la vitesse où vont les possibilités de l’IA, tout personnel humain actuel disparaîtra sinon demain, ni le mois prochain mais dans un an ou, soyons optimiste, dans une décennie : ne serait-ce que pour des professions telles que la mienne basée sur l’écrit, le journaliste ! Il n’y aura plus besoin de journalistes mais pas plus d’avocats ou de magistrats, de comédiens, mais également de chirurgiens ni de personnels pour les pompes funèbres !

Pour Max Tegmark, « La clé pour préserver l’avenir de l’humanité est de concilier la puissance croissante de la technologie et la sagesse avec laquelle nous la gérons. »

Les scientifiques n’avaient semble-t-il pas vu que l’IA pouvait faire des bonds importants en peu voire très peu de temps :

« Il y a six ans, la plupart de mes collègues pensaient encore qu’une IA capable de maîtriser le langage et les connaissances au niveau de ChatGPT-4 relevait de la science-fiction et ne voyaient pas une telle prouesse émerger avant trente ou cinquante ans. Ces gens sont maintenant un peu plus ouverts à l’idée qu’il puisse y avoir d’autres sauts de cette ampleur dans un avenir proche. »

À la question de la journaliste Héloïse Pons :

« Le prochain saut pourrait-il être l’avènement de l’artifical general intelligence, ce stade encore hypothétique durant lequel la machine doit dépasser l’homme dans la totalité de ses capacités cognitives ? »

Le scientifique est formel :

« Je le crains. Sam Altman (ndlr : cofondateur avec Elon Musk de l’organisation OpenAI) affirmait récemment qu’il n’existe plus de grandes inconnues qui empêchent de créer cette superintelligence. Nous savons comment la développer. Je suis très souvent en désaccord avec lui, mais, sur ce point, il a totalement raison. Que nous obtenions l’AGI d’ici quelques années ou non ne dépendra pas de notre capacité à la faire, mais de notre volonté à la faire. Mais il serait absolument insensé de la construire avant d’avoir trouvé comment la contrôler. »

Et Max Tegmark rappelle, à propos des découvertes de nos ancêtres, que « Par le passé, nous obtenions des normes de sécurité en apprenant de nos erreurs. Nous avons d’abord inventé le feu, puis l’extincteur et les règles (…) pour être équipé d’une alarme incendie. Mais lorsque la technologie devient très puissante, apprendre de ses erreurs devient une mauvaise stratégie. »

Ainsi évite-t-on les guerres nucléaires pour ne pas avoir à se dire : « Oups, tirons les leçons de cette erreur ! ».

De même…

« On ne veut pas non plus construire accidentellement une nouvelle espèce plus intelligente que la nôtre et en perdre le contrôle, puisqu’on ne pourra plus en tirer de leçons. »

D’où la nécessité pour l’Homme de garder le contrôle de l’IA, sinon c’est notre disparition comme l’explique le scientifique :

« Si les humains contrôlent les tigres, ce n’est pas parce que nous avons de plus gros biceps ou des dents plus pointues, mais parce que nous sommes plus intelligents. Entre deux espèces, la plus intelligente contrôle l’autre. Donc si nous construisons des robots beaucoup plus intelligents que nous, qui peuvent construire de nouveaux robots encore plus intelligents sans aucun humain, cela constitue une nouvelle espèce puisqu’ils peuvent faire des copies d’eux-mêmes de manière autonome. Et si les objectifs de cette espèce ne vont pas dans notre sens, ce sera tant pis pour nous. Heureusement, nous ne sommes pas obligés de nous mettre dans cette situation puisque c’est nous qui créons ces choses, donc nous pouvons encore garder le contrôle. »

Grâce à sa lettre signée par nombre de personnalités mondiales, lettre « disant que cette technologie pourrait causer l’extinction humaine, ça a ouvert la voie à l’expression de ces préoccupations. On le voit depuis avec l’organisation de sommets clés comme celui de Bletchley Park, au Royaume-Uni, de Corée, ou encore celui à venir de Paris. » Et « la Chine a été la première à mettre en place une réglementation, puis l’Union européenne a suivi.

Comme le dénonce Max Tegmark :

« Je me suis d’ailleurs battu pour cette dernière »…-la réglementation adoptée par l’Union Européenne-…« parce qu’il y a eu une brève période où il semblait que le projet allait s’effondrer notamment à cause de Cédric O, de Mistral, qui faisait du lobbying pour qu’il soit abandonné. » (1)

De notre côté, nous souhaitons plein succès à Max Tegmark et à tous ceux qui approuvent sa mise en garde sur les dangers d’une IA non contrôlée contrairement à d’autres qui semblent vouloir jouer à l’apprenti sorcier, sauf que du temps de Goethe, ce n’était pas l’ensemble de l’espèce humaine qui était mise en danger…

Jacques MARTINEZ, journaliste, à RTL, de stagiaire à chef d’édition des informations de nuit (1967-2001), pigiste à l’AFP, le FIGARO, le PARISIEN…

(1) À propos de Cédric O, ancien secrétaire d’État au… Numérique, lire l’article du journal Capital du 13 décembre 2023 :

« L’ex-ministre Cédric O pourrait empocher 23 millions d’euros après avoir investi 176 euros dans Mistral AI », société fondée à Paris en avril 2023 passée à 2 milliards d’euros fin 2023 -on comprend la position en faveur de l’IA de cet ancien membre du gouvernement- :

https://www.capital.fr/economie-politique/mistral-ai-la-bonne-affaire-du-conseiller-fondateur-cedric-o-1488506

De son côté Wikipedia va jusqu’à évoquer un possible conflit d’intérêt entre la participation de Cédric O à cette société et son appartenance à un gouvernement car…

« En septembre 2023, le Premier Ministre Elisabeth Borne crée le comité de l’intelligence artificielle générative directement rattaché à Matignon. Cédric O est membre de ce comité tout comme Arthur Mensch, cofondateur et CEO de Mistral40. Le magazine Capital et le réseau de média EurActiv relèvent que cette double casquette que porte Cédric O (cofondateur de Mistral AI et conseiller du Gouvernement français sur les régulations de l’IA à adopter) fait grandir les soupçons de conflit d’intérêts. En tant que lobbyiste pour Mistral AI, Cédric O est considéré comme le grand artisan de l’opposition ferme de la France à la législation sur l’intelligence artificielle (AI Act) proposée par la Commission européenne. »

Wikipedia s’appuie sur deux documents :

1/« Théophane Hartmann, « AI Act : le gouvernement accusé d’avoir été influencé par un lobbyiste en situation de conflit d’intérêts [archive] », sur Euractiv, 21 décembre 2023 (consulté le 12 septembre 2024) »

et 2/ « Théophane Hartmann, « Les coulisses de l’opposition de la France à la réglementation des modèles d’IA [archive] », sur Euractiv, 29 novembre 2023 (consulté le 12 septembre 2024) »

833 total views, 1 views today

L’IA en soi n’est pas dangereuse. Ce n’est pas une intelligence à proprement dit. Ce sont des supercalculateurs qui travaillent à une vitesse inconcevable. Là où l’IA devient dangereuse c’est quand elle sera dotée de sentiments. Or ce n’est pas pour demain. Les dangers de l’IA – de nos jours – proviennent de ce que l’humain fait de cette IA. Mais si jamais l’on dote l’IA de sentiments, le danger seras intrinsèque à l’IA. C’est ce qui devrait nous inquiéter.

Les pires dystopies de Science Fiction peuvent se réaliser dans le présent ou le futur proche.

L’intelligence des ordinateurs et des machines échappant aux humains et les asservissant, c’est un thème classique et rebattu de la science-fiction depuis bien longtemps.

Nous y voici.

Et les solutions sont toutes suggérées dans la science-fiction.

On appelle « intelligence artificielle » ce qui n’est qu’un croisement de données plus sophistiqué que celui proposé par les antiques tableurs, et plus performant du fait d’une puissance de calcul plus forte. Le jour où une machine s’apercevra qu’elle s’est trompée et qu’elle l’admettra, alors là, oui, nous aurons une intelligence artificielle. Les « IA » actuelles en sont loin.

Exactement, Henri. Mais en attendant la véritable intelligence, ces systèmes élaborés de programmes accumulés surclassent de fait la capacité et al vitesse de décision des humains.

Et, peut-être plus effrayant, ce qu’on appelle intelligence (humains) est peut-être plus limité en réalité que ce qu’on imagine.

Ce qu’on en fait pour gouverner les hommes à l’heure actuelle semble bien l’être en tout cas.

et c est l ia qui bossera pour payer les allocs de certains ???

plus besoin d humain grace a l ia donc pas la peine de se faire du souci !

Quand l’IA aura remplacé l’humain celui-ci aura tellement de temps libre que l’oisiveté le tuera.

Ça me fait penser ceux qui ne veulent bosser que 4 jours par semaine pour bien se faire chier les 3 autres.

À la tête de l’État, beaucoup manque d’intelligence naturelle. Ce qui explique leur manque de peur devant l’IA.